L’impiego dell’intelligenza artificiale (IA) nel settore militare potrebbe portare a una guerra nucleare tra USA e Russia. Di quest’opinione è l’ex vicesegretario alla Difesa USA Robert Work il quale cita la fonte di Breaking Defense. Spieghiamo bene che non si tratta di robot impazziti che violano gli ordini loro impartiti dagli umani e sganciano sulla Terra centinaia di missili nucleari, ma di errori commessi dall’IA, possibili in situazioni in cui ad essa siano stati delegati i poteri decisionali su un attacco: infatti, cosa succederebbe se l’IA considerasse dei fattori privi di rischio come una minaccia? Lo scenario sembra terribile. Cerchiamo di capire in quali settori dell’esercito viene oggi impiegata l’IA. Questi settori sono 5:

- Software di sistema dei mezzi militari

- Sistemi informatici di gestione dei singoli componenti di mezzi militari

- Sistemi informatici dei sistemi di armamenti

- Sistemi informatici di gestione e scambio di informazioni relative a componenti del mezzo

- Sistemi informatici a supporto del processo decisionale operato dai dirigenti militari

Dimmi come attaccare.

Del primo settore fanno parte i software di gestione delle operazioni, come i missili di puntamento automatico, i sistemi digitali di navigazione inerziale o, ad esempio, i sistemi di gestione motori di un velivolo o carro armato moderno. I sistemi informatici di questo tipo sono disponibili ormai da decine di anni, ma non vengono utilizzati appieno. La seconda tipologia sono i sistemi informatici di gestione di mezzi militari complessi. In questi sistemi possono essere impiegati algoritmi altamente tecnologici per l'analisi integrata dei dati rilevati dal mezzo, nonché per l’elargizione di raccomandazioni all'equipaggio.

Iskander-M.

Il terzo tipo di software permette al mezzo di operare con diverse strumentazioni integrate nel sistema di armamenti. Ad esempio, all'interno del moderno sistema missilistico Iskander-M vi sono due piattaforme di lancio, un transporter-caricatore, una centrale di raccolta ed elaborazione dei dati relativi al bersaglio e un posto di comando. La gestione di tutte le unità del sistema è effettuata da un apposito software che interagisce con i software dei singoli componenti del mezzo. Qui vengono applicate le nuove tecnologie, ma come per la creazione dei software per i componenti singoli anche qui l’introduzione dei programmi avviene gradualmente. La quarta tipologia è quella dei grandi sistemi che garantiscono la gestione dei mezzi a livello di divisioni militari. Qui la comparsa di nuove tecnologie informatiche ha generato una vera e propria rivoluzione poiché sta permettendo di gestire ogni divisione dell’esercito e ogni componente di un mezzo a qualunque distanza e in tempo reale. Sistemi di questo tipo operano su due fronti: raccolta, analisi e presentazione dei dati agli esperti del centro di controllo e ad altri utenti, nonché trasmissione degli ordini provenienti dal quartier generale alle strutture sottostanti.

Come funziona? Alla ricerca di missili da crociera.

Consideriamo un semplice esempio di raccolta e analisi di dati con l’impiego delle moderne tecnologie. L’analisi del comportamento di migliaia di camion portacontainer sulle strade di un dato Paese permette al sistema intelligente di suddividere in base ad alcuni modelli comportamentali i veicoli che probabilmente stanno trasportando piattaforme camuffate per il lancio di missili da crociera. Ottenere dati in base ai flussi di traffico con l’aiuto dei moderni sistemi satellitari non è difficile. Il resto è il risultato del lavoro di un gruppo di esperti e dell’apposito software. Un esempio ancor più lampante è quando sulla base di dati fallaci si conclude grazie all’IA che in un dato luogo si potrebbe trovare una divisione o quartier generale che fino ad allora non erano stati rilevati dai sistemi di ricognizione visivi o radio. E chiaramente sistemi simili sono in grado di raccogliere dati provenienti da tutti i sistemi sottostanti, nonché da sistemi analoghi e superiori. In tal modo, è possibile creare un unico spazio informatico dedicato alle operazioni militari. Inoltre, limitandone il grado di accesso possono usufruire di questo spazio informatico anche i sistemi sottostanti, come i carri armati, i natanti e i velivoli. Così si verranno a formare nuove possibilità in campo informatico per la gestione del combattimento moderno: ad esempio, quando un pilota vedrà velivoli nemici identificati da una nave e potrà seguirli sullo schermo. In parte questi sistemi sono già stati realizzati, ma non vengono ancora utilizzati in maniera diffusa.

E la guerra nucleare?

Veniamo ora a ciò di cui parla Breaking Defense: il controllo sugli armamenti nucleari, il sistema russo Perimetr et similia. La quinta tipologia di sistemi che impiegano l’IA sono i cosiddetti sistemi di supporto al processo decisionale. Sono realmente in grado di creare nuove informazioni: presentare risorse del nemico fino ad allora nascoste, prevedere sue azioni ed elaborare scenari di sue reazioni in base a date condizioni e considerate le sue risorse. Per definizione questi sistemi cercano di operare decisioni il più possibile affidabili poiché il costo di un errore in questi casi è elevatissimo. Tuttavia, uno dei primi sistemi ad aver implementato un processo decisionale senza partecipazione umana è stato il sovietico Perimetr che teoricamente doveva assicurare la risposta con missili balistici intercontinentali in caso di distruzione del direttivo militare. Utilizziamo la parola “teoricamente” perché tutte le informazioni relative al Perimetr sono segretate. Non vi sono dati ufficiali circa le decisioni “automatiche” prese dal Perimetr. Ad ogni modo sempre teoricamente si ritiene che proprio il Perimetr utilizzi algoritmi che permettono grazie a diverse sottostrutture di gestione di assicurare la difesa da lanci non autorizzati.

Un terremoto potrebbe far partire i missili russi?

L’ex vicesegretario USA alla Difesa Robert Work nel sopraccitato articolo di Breaking Defense teme che il Perimetr possa scambiare l’attività sismica per esplosioni nucleari e, dunque, inviare una richiesta di reazione al quartier generale. Qualora non ricevesse (subito) risposta “umana”, lancerebbe i missili balistici intercontinentali. Tutto ciò è davvero poco probabile. Infatti, è estremamente difficile confondere il profilo sismico di un’esplosione nucleare con quello di un terremoto di origine naturale. Inoltre, è difficile anche solo immaginarsi che il Perimetr prenda una decisione in base ai soli dati dei rilevatori sismici, senza quindi valutare informazioni di attacco provenienti dai sistemi di allerta di attacchi missilistici o dai sistemi di difesa antimissilistica. Questi sistemi, a loro volta, non possono essere distrutti senza lasciare traccia, dunque in ogni caso il Perimetr non rimarrebbe senza i propri “organi di senso”. Dunque, qualora nessuno avesse lanciato missili o mezzi di altro tipo, ma vi fosse stato un fenomeno sismico localizzato, il Perimetr con una probabilità di circa il 100% non considererebbe quest’eventualità come una guerra. Nemmeno nel caso ipotetico che, ad esempio, il Quartier generale non avesse risposto alle richieste del Perimetr. Inoltre, qualora rimanesse operativo uno dei punti di controllo di emergenza o il Cremlino, questo porterebbe comunque il Perimetr a escludere l’ipotesi di una guerra in corso e non costituirebbe pretesto per il lancio di missili balistici intercontinentali.

L’uomo sovietico è più affidabile di una macchina.

Tuttavia, la teoria dell’attivazione automatica del Perimetr si discosta dal tradizionale conservatorismo che ha caratterizzato le scelte tecniche e strategiche dell’Unione Sovietica. Infatti, laddove era possibile impiegare un umano, veniva fatto. L’URSS non affidava il processo decisionale ad alcun sistema informatico. Oggi a tale conservatorismo si aggiunge anche una data mancanza di preparazione ad affrontare i più moderni software, sebbene la scuola di programmazione russa disponga di un grande potenziale. Dunque, l’impiego dei software più moderni che sfruttano l’AI è una questione di mera volontà politica e di comprensione dei concetti che regolano l’applicazione di tali software. In parole povere: quando si deciderà cosa e come utilizzare e in che misura sia possibile affidare il destino dei sistemi di difesa a dei computer, lo si farà in tempi molto brevi. A mio avviso, nel giro di 3-5 anni.

Fonte: https://it.sputniknews.com

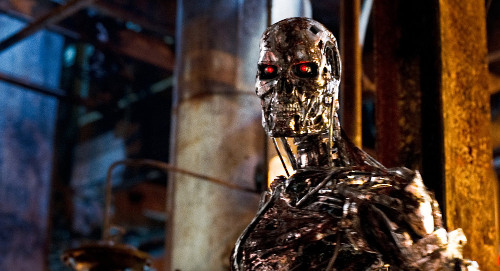

I sistemi di controllo arma basati su IA sofisticatissime potrebbero portare in un prossimo futuro allo scoppio di conflitti nucleari su scala mondiale. È questa l'opinione dell'ex segretario della Difesa americano Robert Work, in carica a cavallo tra la fine dell'amministrazione Obama e quella di Donald Trump. Work, come riportato da Breaking Defense, ha voluto dire la sua circa la "Campagna per fermare i robot killer" (Campaign to stop killer robots), attiva dal 2012 in ambito internazionale per l'introduzione del divieto assoluto di impiego di armamenti controllati unicamente dalle IA. Secondo il politico americano, il vero rischio non sarebbe però quello di vedere realizzato uno scenario simile a quello del blockbuster holliwoodiano "Terminator", con dei sanguinari robot pronti a prendere il controllo della Terra, come sostenuto dagli attivisti della iniziativa. Piuttosto, se si continuerà in direzione di una fortissima automatizzazione degli armamenti, in un futuro neanche troppo lontano potremmo trovarci a fare i conti con interi arsenali nucleari gestiti interamente delle IA. Work sostiene l'applicazione di tali sistemi di controllo arma agli arsenali atomici delle grandi potenze mondiali potrebbe avere delle conseguenze nefaste per l'umanità, in quanto porterebbe a una loro attivazione in base a determinati parametri e fattori numerici, previsti dagli algoritmi di progettazione. In determinati casi, ad esempio, le IA potrebbero sovrastimare dei fattori di rischio previsti in fase di progettazione, portando a una escalation probabilmente irreversibile dei conflitti nucleari. All'avverarsi di un tale scenario, quindi, verrebbe messo completamente fuori causa quel fattore che, con tutta probabilità, ha impedito lo scoppio di conflitti atomici su scala mondiale dall'invenzione della bomba nucleare fino al giorno d'oggi: il buon senso. Una simile situazione, tanto realistica quanto angosciante sotto molti punti di vista, è stata teorizzata dallo stesso Work: "Immaginatevi una situazione in cui l'IA che controlla l'arsenale nucleare cinese, dopo aver analizzato alcuni dati, avvisa che gli USA si stanno preparando a lanciare degli ordigni in Cina e invita a sua volta a effettuare un attacco preventivo". A conclusione del suo intervento Work ha poi voluto comunque ribadire che un impiego limitato e controllato delle intelligenze artificiali potrebbe portare dei concreti vantaggi in ambito militare. Nei giorni scorsi un'opinione simile a quella dell'ex segretario della Difesa americano era stata espressa da Elon Musk, che a margine di una conferenza aveva avvisato sul possibile rischio di una 'dominazione' del mondo da parte di intelligenze artificiali sempre più avanzate e sofisticate.

Fonte: https://it.sputniknews.com